Hallo Klaus und Stoneage,

zum Link

http://www.dpreview.com/forums/post/50578456 muß ich etwas erzählen:

Ich hatte mich aufgrund der mangelnden Silkypix-Untersützung für die Merrills in den Thread eingeklinkt und interessante Antworten von Arvo Jägel erhalten. Daß sich auch besagter J. Wisniewski geäußert hat, ist mir entgangen. Ich hab' das Posting erst vor ein paar Tagen entdeckt, als ich den Thread ausgegraben habe.

Mich interessieren seine Äußerungen, weil es sich bei ihm um einen Softwareentwickler zu handeln scheint, der schon einmal etwas in Richtung Foveondatenaufbereitung programmiert hat. Ich kaufe ihm das durchaus ab. Das, was er da schreibt, trägt nicht die Handschrift einer Schaustellers.

Wie Stoneage schon sagt, ist gerade der Passus über die Highlights, ein Teil, bei dem ich ungläubig den Kopf geschüttelt habe (es gibt da sehr gutmütige Foveons, lassen wir die Dpx'en und SD15 mal außenvor), der mich andererseits aber auch sehr neugierig macht.

So etwas kann man ggf. forcieren und schauen ob die anderen Kanäle auch betroffen sind.

Ich habe ja versucht darzulegen, dass die Foveon-Sensorebenen nicht Farbsignale sehen, sondern, den Gesetzmäßgkeiten der Halbleiterphysik und der Transmission durch Siliziumschichten folgend, detektieren.

Warum sollte es nicht möglich sein, z.B. bei 600nm (also orangerot) alle drei Kanäle gleichzeitig zu überfluten? Alles eine Frage der Einstrahlintensität, da bei dieser Wellenlänge blau und grün auch ansprechen.

Muß ich mal ausprobieren.

Zum Inhalt des Postings:

Es ergab sich, dass die Frage aufkam, ob man der Entwicklung von dcraw (der RAW-Konverter von Dave Coffin) nicht nachhelfen könnte, indem man Color-Target-Aufnahmen zur Verfügung stellt, die der Farbkalibrierung dienen sollen.

Warum? Weil dcraw für Merrills zurzeit noch solche Bilder liefert:

http://www.dpreview.com/forums/post/50495475

Arvo hat erläutert, dass dies nicht zielführend sei.

Zu den Ausagen von Wisniewski:

1.)

Wisniewski spricht zunächst etwas an, was ich vollkommen nachvollziehen kann: Ein Foveon ist nicht per se farbensehend - und schon gar nicht schichtenbezogen

selektiv farbensehend. Er nennt das "noncolorimetric". (Bayer'sches Silizium wird auch nur deswegen "farbensehend", weil

echte Farbfilter vor entsprechende Pixel vorgeschaltet sind - ein Foveon hat aber keine Farbfilter jenseits des UV/IR-Sperrfilters).

Wie kann man also die Grundlage schaffen, Farben aus den Signalen zu konstruieren? "Ganz einfach": Indem man für den zu kalibrierenden Foveonsensor, Fingerabdrücke zur jeder Wellenlänge aufzeichnet: Jede Wellenlänge eines kontinuierlichen Spektrums ist charakterisiert durch ein Tripel (ich nenne sie hier mal bewußt nicht R/G/B, sondern Ebene 1, Ebene2 und Ebene3) entsprechender Quantenausbeuten (Quanteneffizienzen) der jeweiligen Sensorebenen. Verwendet man nun einen

Monochromator mit dem man den Sensor bestrahlt, kann man das Lichtspektrum -diskret, Wellenlänge für Wellenlänge- durchwandern und dabei entsprechende Sensordatentripel aufzeichnen. Eine Datenbank zum Abgleich von Signalausbeuten entsteht, anhand derer man (den Fingerabdrücken) Wellenlängen zuordnen kann.

So eine Datenbank kann theoretisch beliebig groß werden. Mit wie vielen diskrete Wellenlängen möchte man denn ein kontinuierliches Spektrum annähern. 10? 100? 10^18?

Also beschränkt man sich auf entsprechende sinnvolle Anzahl von Stützstellen, z.B. in 10nm-Abständen.

Und was macht man mit den Lücken dazwischen. Richtig: Die Werte dazwischen

interpoliert man mit hinreichender Genauigkeit.

Für die erforderlichen Interpolations und Matrixoperationen schlägt Wisniewski das Open Source Werkzeug Little CMS (Color Management System) vor:

http://www.littlecms.com/

2.)

Mehr Kopfzerbrechen bereitet mir, wie Wisniewski das Signalverhalten des Foveons beim Ausbrennen eines Ebenenkanals beschreibt. Er meint, dass wenn ein Kanal ausbrennt ("blowouts"), alle anderen auch unbrauchbar werden und dass die RAW-Prozessoren für Foveon-Daten vollumfängliche inpainting-Algorithmen (inapainting = Rekonstruktion) verwenden, um diesen Umstand abzumildern.

Zunächst einmal ist mir klar, dass durchaus auch alle drei Kanäle gleichzeitig durchbrennen können. Ich hatte dies eingangs (in diesem Posting) erwähnt. Das meint er aber wahrscheinlich nicht.

Gedankenspiel: Was passiert, wenn, sagen wir mal, der Rotkanal völlig durchgebraten wird?

Wie sieht dann die Fingerabdrucksuche in der Signaltripel-Datenbank aus?

Ist da überhaupt ein passender?

Man stelle sich mal den Aufwand vor, eine Signaldatenbank für den Foveon mit gezielter Reproduktion einzeln ausgebrannter Signalkanäle zu erstellen.

Ich denke schon, dass da Rekonstruktionsalgorithmen im SPP vorhanden sind.

Wisniwski sagt:

"Currently, SPP uses full fledged inpainting for blowouts. Sometimes that works, other times, you get weird textures in the blowouts. That "signature" is what let me figure out WTF Foveon was doing."

WTF übersetze ich mal nicht.

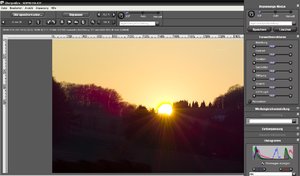

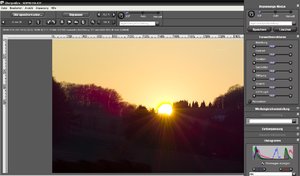

Verrückte Texturen in der ausbrandrekonstruktionszone? Ja die kenne ich - von der SD14, siehe die Koronastruktur um die Sonne.

Und noch einmal die im X3F eingebettete jpeg Voransicht ohne SPP-Processing:

Wisniewski empfiehlt als Eigenbau-Strategie für einen Foveon-RAW-Konverter auf die Rekonstruktionsalgorithmen von Paul Harrison auf Basis seiner Doktorarbeit entwickelt hat...

http://www.logarithmic.net/pfh/

http://www.logarithmic.net/pfh/publications

Harrison hat auch den "Resynthesizer" (manche kennen ihn sicher als gimp-Plugin) programmiert, der in etwa dem Werkzeug für "bereichssensitive Füllen" eines bekannten Softwareherstellers entspricht.

Das Ganze natürlich im Spitzlichter-Kontext als Rekonstruktionswerkzeug physikalisch nicht in der Datenbank registrierter Sensor-Readouts (Stichwort Fingerabdrücke).

Was bedeutet so eine Rekonstruktion "nicht kartografierter" Farbsignal-Tripel, sofern seine Aussagen richtig sind? Richtig: Es werden an solchen Stellen Farbwerte

geschätzt.

3.)

Er spricht über etwas, das er Rotkanalschärfung nennt.

Hier hängt er mich allerdings ab.

Er behauptet, dass die Interpolation nach

1.) nicht ausreicht um bei der "Schärfung der Rotkanals" keine Abweichungen in orange gelb und grün zu erhalten.

Er schlägt hierfür vor, das Spektum in 50nm-Bereiche zu unterteilen und mit unterschiedlichen Radien zu schärfen...

Kann sein, aber da spricht ein Softwareentwickler aus seinem persönlichen Erfahrungsnähkästchen. Ich kann so etwas nicht logisch nachhalten.

Ich glaube aber, dass dieser Passus nicht sonderlich relevant ist, um ein Grundverständnis für den Foveon zu erhalten.

-----

Soweit

mein Verständnis zu dem, was im Wisniewski-Link steht.

Für mich am interessantesten ist Passus

1.). Er räumt auf mit der Mähr des vollfarbsehenden Foveons. Aber man sieht ja auch an den Foveon-Endergebnissen, dass man die Sensorphysik mit vernünftigen Algorithmen und Datenbanken bestens beherrschen kann.

Grüße,

Oz