Über das Sensorprinzip habe ich noch mal länger nachgedacht. Ich glaube so abwegig ist das Ganze nicht.

Nachfolgend so, wie ich es zu verstehen glaube...

Nachfolgend so, wie ich es zu verstehen glaube...

Ich habe in diesem Forum ja schon einiges über den herkömmlichen Foveon-Sensor geschrieben:

------

Quelle1--------------------------------------------

"

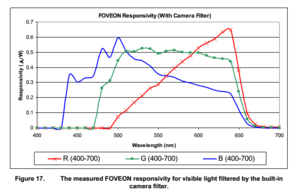

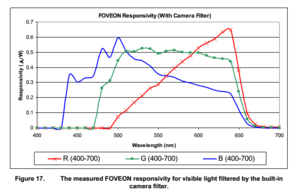

Beim Foveon-Sensor ist die Sensorebene geschichtet - alle Farbinformationen werden je Pixel aufgezeichnet, ortsaufgelöst untereinander: Da ist eine "Blauebene", eine "Grünebene" und eine "Rotebene", die bei verbauten/ausgebauten Sperrfilter eine Empflindlichkeit aufweisen wie sie in nachfolgender Publikation

http://www.dtic.mil/cgi-bin/GetTRDoc?AD=ADA429699

dargestellt ist (S.27, Bild17: Mit Sperrfilter <-----> S.28, Bild18: Ohne Sperrfilter).

Aus diesem Signalwust rechnet z.B. SPP bei klassischen Farbbildern (durch eine entsprechend komplexe Farbkalibrierung) die entspechenden Farbkomponenten des Bildes. Darauf ist SPP ausgelegt."

------

Quelle2--------------------------------------------

Die Farbermittlung auf Basis der wellenlängenabhängigen Eindring

tiefe der Photonen in die Siliziumschichten des Foveons ist aber eine haarige Angelegenheit.

Ich bin mir recht sicher, dass dort enorm viel Kalibrierarbeit bei der Sensorentwicklung und der Anpassung der verarbeitenden Einheiten erforderlich ist.

S.27 in der nachfolgenden Thesis zeigt das ganz gut. Dort wurde ein Foveon mit einem Monochromator vermessen.

http://www.dtic.mil/cgi-bin/GetTRDoc?AD=ADA429699

Die "blaue Schicht" des Foveon (blau?) sieht nicht nur blau, sondern alles!! Blau, rot, grün.

Die "grüne Lage" kriegt schon weniger von dem in der oberen, "blauen Lage" absorbierten kurzwelligen Lichtbestandteilen mit. Dies gilt natürlich umso stärker für die unterste Lage - jene, die für die "Rot"-Detektion zuständig ist.

Das muss man sich mal auf der Zunge zergehen lassen:

Die blauabsorbierende Schicht sieht (und detektiert!) das ganze optische Spektrum von violettblau bis dunkelrot (420nm - 670nm).

Die grünabsorbierende Schicht sieht von blaugrün bis dunkelrot (470 - 670nm).

Die rotabsorbierende Schicht sieht von grün bis dunkelrot (490 - 670nm).

Es ist auch logisch, da Photodioden im Silizium des Foven nicht zwischen Farben unterscheiden. (Genausowenig, wie ein Bayer-Sensor ohne Farbfilter Farben in der Pixelebene unterscheiden kann.)

--------------------------------------------------

Genug zitiert.

Die oberste Sensorebene des Quattro-Foveon ist erheblich (4x höher) aufgelöst, als die unteren beiden Ebenen.

Farben rekonstruiert man beim ursprünglichen Foveon aus den charakteristischen Tripeln der Quantenausbeuten (aus der oberen, mittleren und unteren Ebene), die sich bei entsprechenden Licht-Wellenlängen ergeben. Jede Wellenlänge hat einen charakteristischen Fingerabdruck aus den drei Ebenen eines Pixels.

Der Nachteil ist, dass das Signal-Rausch-Verhältnis der tiefer liegenden Ebenen schlechter wird. Dem kann man entgegnen, indem man die Pixel größer macht. Die größere Fläche dieser Pixel sammelt mehr Photonen pro Pixel.

Die Frage ist: Wie korrespondiert das nun mit der 4-fach höheren Pixeldichte des Quattro-Foveon in der obersten Sensorebene.

Ist diese oberste Ebene wirklich nur imstande, Luminanzwerte Helligkeitswerte) zu registrieren?

Ich denke nicht.

Betrachtet man die Quantenausbeuten der einzelnen Ebenen eines Foveon,

Quelle:

http://www.dtic.mil/cgi-bin/GetTRDoc?AD=ADA429699 ,S. 27

so erkennt man, dass die Ausbeuten der obersten ("blau"-Ebene) in Abhängigkeit von der Wellenlänge durchaus charakteristisch (für jede Wellenlänge anders) ist. Da ist mehr Information als nur Hell-Dunkel!

Reicht dies aus, um alleine eine Farbe sicher zu charakterisieren? Praktisch dürfte das sehr schwierig sein (Trennschärfe eng benachbarter Wellenlängen in Abhängigkeit von der Quantenausbeute). Wenn es reibunglos ginge, so bräuchten auch "Bayer"-Sensoren keine Farbfilter.

Klappt eine Charakterisierung mit Unterstützung der unteren Ebenen? Ja, bekanntermaßen.

Die Frage ist, ob nun jedem "Blau"-Pixel unbedingt jeweils ein "Grün" und "Rot"pixel beigestellt werden MUSS. Oder wird eine spezifische Wellenge auch mit Unterstützung gröberen Tiefenpixeln hinreichend genau (Ergebnis: Farbfehler = sehr klein) charakterisiert?

Diese Frage dürften die Foveon-Ingenieure für sich mit "ja" beantwortet haben. Sonst hätten sie diesen Ansatz nicht bis zur Marktreife entwickelt.

Sicher muss so ein Quattro-Foveon-Sensor speziell vermessen/kalibriert werden (über Monochromator), da die unteren Ebenen anders (viel empfindlicher) reagieren.

Am fertigen Sensor würde ich das nicht machen, sondern eher an einem Testsensor mit einem einzigen Pixel-Tripel mit den jeweiligen Pixeldimensionen (Top-Ebene, Mittelebene, Bottom-Ebene).

Mit einem angepassten Algorithmus, mit dem die Quantenausbeute, vornehmlich der oberen Ebene, mit den unteren Assist-Ebenen korreliert wird, könnte das gut funktionieren.

Es ist IMHO immer noch allemal besser, als eine Bayer-Interpolation in der Ebene.

Ich bin daher wirklich gespannt auf die ersten X3Fs.

Eine deutlich höhere ISO-Tauglichkeit sowie eine vollwertige Auflösung auf Niveau der oberen Sensorebene bei einer immer noch Foveon-typischen (oder -ähnlichen) Bildanmutung würde mich nicht wundern.

Soweit zumindest mein Versuch, das Quattro-Prinzip zu verstehen und meine Erwartungen.

Sachdienliche Ergänzungen gerne erwünscht.